MM-LLMs: Recent Advances in MultiModal Large Language Models

https://arxiv.org/abs/2401.13601

Multi Modal Model

1. 概要

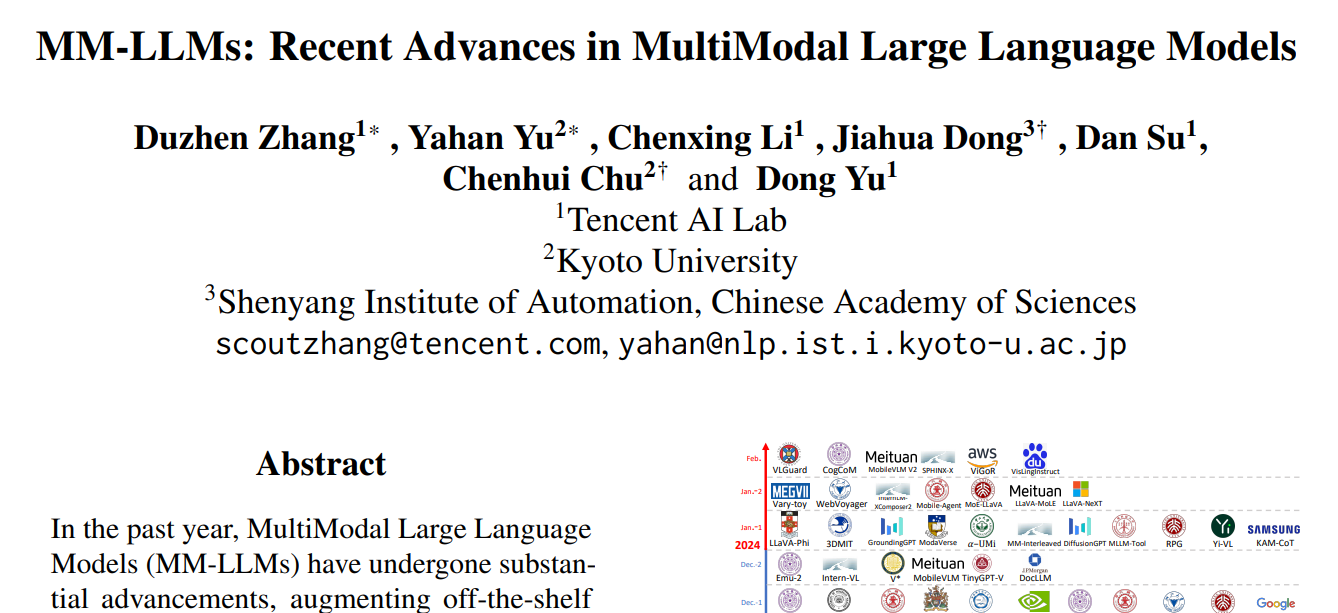

2022年以降に登場したマルチモーダルモデル(MMM)の包括的なサーベイを行い,122個のMMMについてベンチマークを行った

ベンチマークからMMMの効率的なトレーニング方法をまとめ,リアルタイムで最新動向を管理するウェブサイトを公開

2. モデルアーキテクチャの分類

Modality Encoder

多様なモダリティからの入力を符号化し,対応する特徴量を得る役割(いわゆるEncoder)

Imageの例:

NFNet-F6, ViT, CLIP ViT, Eva-CLIP ViT, BEiT-3, OpenCLIP, Swin-T based Grounding DINO, DINOv2, SAM-HQ with MAE, RAM++ with SWIN-B, InternViT, VCoder Audioの例:

C-Former, HuBERT, BEATs, Whisper, CLAP 3D Point Cloud Modalityの例:

Any-to-Anyの例:

Input Projector

他のモダリティの特徴量をテキスト空間にマッピングさせる役割

マッピングされた特徴量はテキスト特徴と一緒にLLMに渡される 以下の損失を最小化することが目的

モデル例:

(M)LP, Crooss Attention, Q-Former, P-Former, MQ-Former,

LLM Backbone

様々なモダリティからの特徴量を処理し意味理解・推論・入力に関する意思決定を行う役割

Zero-Shot,In-Context Learning,Chain-of-Thought,Instruction FollowingといったLLMの特性はMMMになっても引き継がれる 直接的なテキスト出力t,他のモダリティからのシグナルトークンSxを出力

モデル例:

Flan-T5, ChatGLM, UL2, Persimmon, Qwen, Chinchilla, OPT, PaLM, LLaMA, LLaMA2, Vicuna

Output Projector

LLMからの信号トークン表現Sxをモダリティ生成器MGxに理解可能な特徴量Hxにマッピングする役割

以下のようにHxとMGxの距離の最小化を行うことでHxのアラインメントを学習

モデル例:

MLP, Tiny Transormer(Decoder)

Modality Generator

異なるモダリティの出力を生成

画像ならStable Diffusion,ビデオならZeroscope,音声ならAudioLDM2 以下のように条件付きLDM損失を用いて逆拡散過程を学習

3. 学習パイプライン

MM PTではXTextデータセットを用いて学習

MM ITでは命令フォーマットされたデータセットを用いてMMMを微調整する

教師ありファインチューニング(SFT)と人間による強化学習(RLHF)からなる SFT:MM PTのデータの一部を命令形式に変換して利用 QAの場合の例: "<Image>{Question}"という形式のデータを抽出 → "<Image>" Examine the image and respond to the following question with a brief answer:"{Question}. Answer:"; と変換して利用 RLHF:人間によるフィードバックを報酬とした強化学習でモデルを微調整

4. MMMの包括的分類

122のMMMを帰納的観点・設計的観点から分類

Tool usingはLLMをブラックボックスとして扱っていること,End-to-Endはモデルが共同学習されていることを意味 43の主要なMMMを包括的に比較

MMの理解モデルからMMの生成モデルへ進化(MiniGPT-4 -> MiniGPT-5 -> NExT-GPT) SFTからRLHFに進化し,人間の糸に沿うように会話能力を向上(BLIP-2 -> InstructBLIP -> DRESS) モダリティの拡張(BLIP-2 -> XLLM x InstructBLIP -> X-InstructBLIP) データセットの高品質化(LLaVA -> LLaVA1.5) より効率の良いモデルアーキテクチャの採用(Q-Former, P-Former -> Linear Projector(VILA))

5. MMMのベンチマーク

18個のVLタスクで主流MMMをベンチマーク

解像度が高いほど性能向上に影響を与え,LLaVA-1.5とVILAは336*336,Qwen-VLとMiniGPT-v2は448*448を採用 MiniGPT-v2では計算コストを下げるため隣接する4つの視覚的トークンを連結 などして工夫 Monkeyは高解像度のEncoderを凍結することで1300*800,DocPediaは更に2560*2560に対応させた データセットの品質も重要であり,LLaVA1.5やVILAはShareGPT4Vの採用により性能向上を達成 LLMでParameter-Efficient Fine-Tuning(PEFT)を行うことでICLに重要な深い埋め込みアラインメントを促進 SFTに不自然な指示などを混ぜることでVLタスクの性能が向上

6. 付録の紹介部分を簡単に

Modality Encoder

NFNet-F6:Normalizer freeのResNet

Mainstream PEFT Methods

Prefix-tuning:AttentionのK, Vに学習可能トークンを導入

Adapter:ダウンサンプリング,非線形活性化,アップサンプリングの残差接続

LoRA:重み行列を低ランク行列で近似して学習,元の重みに加算

QLoRA:LoRAを4bit量子化

Layer Norm tuning:LayerNorm層をFT or LoRA

その他:P-tuning, P-tuning v2, Adapt-Bias, Compacter, AdapterFormer, XTuner, P-LoRA, MoLE, Delta-LoRA

Representative LLMs

Flan-T5:Encoer-DecoderですべてのNLPタスクを扱うT5をFLANでFT

InternLM:多言語対応1兆パラメータモデル

UL2:Encoer-Decoderに逆拡散過程を追加

OPT:GPT-3のクローン

PaLM:並列AttentionとFFNによる計量モデル

Vicuna:ShareGPTのデータでLLaMAをSFT